Hoy Instagram anunció dos nuevas herramientas que ayudarán a los usuarios a combatir el acoso (bullying).

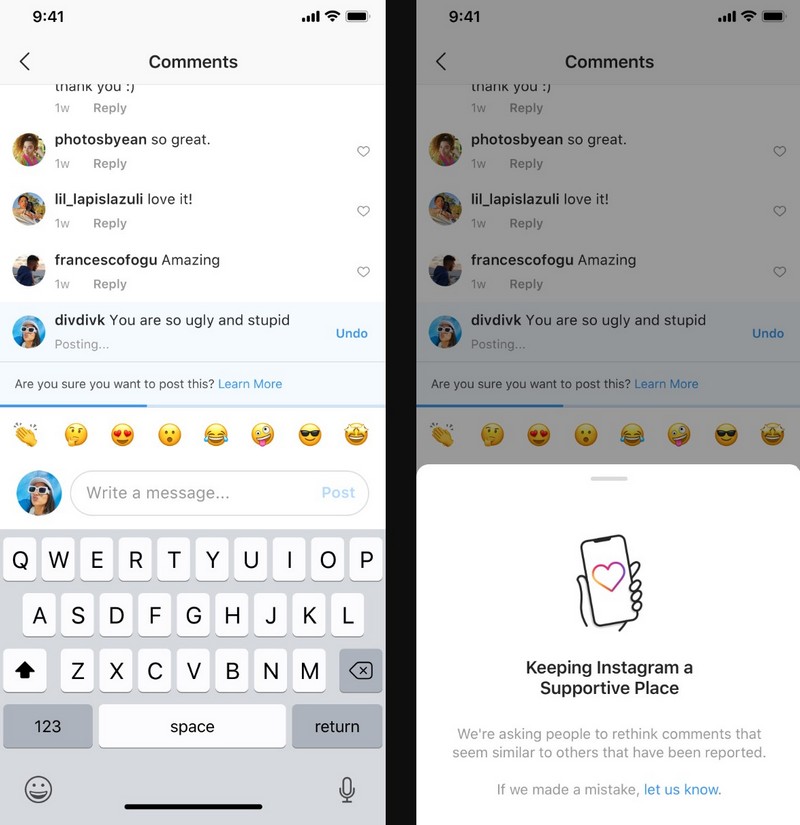

La primera de esas herramientas avisa a los usuarios si un comentario puede llegar a ser ofensivo. Esta herramienta se basa en Inteligencia Artificial y es una forma de hacer pensar dos veces al usuario al usuario que está por realizar un comentario.

Cuando la aplicación de Instagram detecta un comentario que se puede considerar de acoso (ofensivo) hacia la persona que publicó contenido, muestra una ventana emergente que explica y pide que vuelvan a pensar antes de comentar.

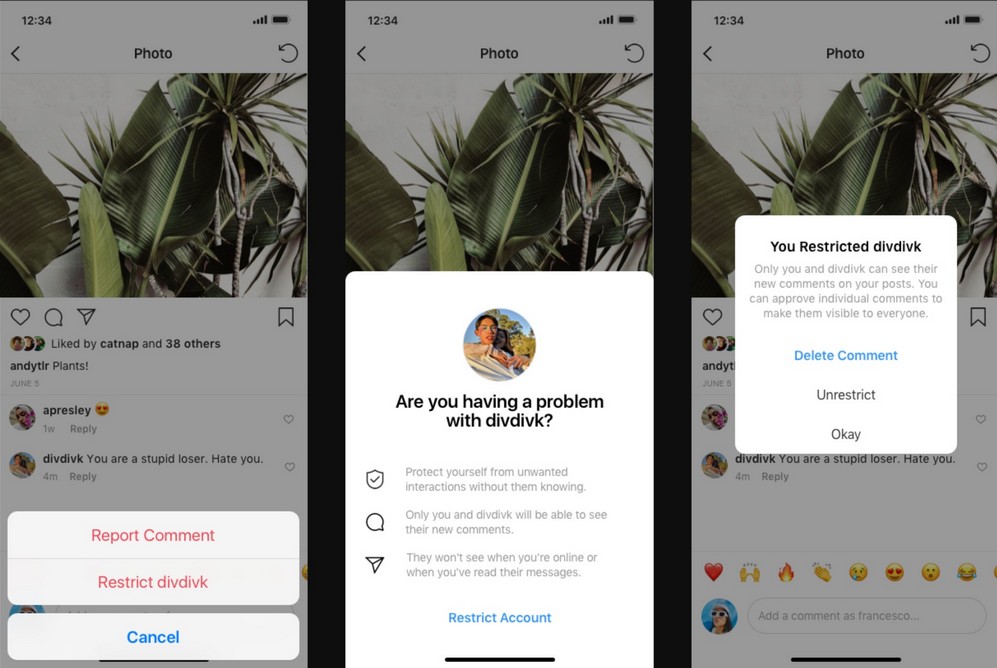

La otra herramienta para combatir el acoso se llama Restringir (en inglés Restrict), permitirá a los usuarios que publican contenido moderar a los followers que causan problemas con sus comentarios. Los comentarios no serán vistos por el público al menos que el usuario los apruebe y los deje aparecer en su publicación.

Además los usuarios en la lista Restringir tampoco podrán conocer cuando el usuarios que los tiene en esa lista está en línea o cuando leyó sus mensajes directos.

Respecto a estas nuevas dos características Adam Mosseri, quien está a cargo de Instagrram, comentó lo siguiente,

Es nuestra responsabilidad crear un entorno seguro en Instagram. Esta ha sido una prioridad importante para nosotros durante algún tiempo, y seguimos invirtiendo para comprender mejor y abordar este problema. Espero poder compartir más actualizaciones pronto.

por

por